Triton生态内少有CPU架构的实践,且多面向Host-Device的异构方案,进迭时空通过同构融合RISC-V AI CPU技术,结合Triton轻量化的交互式编程模式,将构建起比肩Triton GPGPU的AI高性能编程方案,从而推动AI应用的快速规模化落地。

2025年初Bit-Brick出品了第一款进迭时空的K1开发板,我第一时间就入手了。跟着论坛的帖子,我很快就在这款RISC-V融核处理器上跑起来了一个小语言模型,体验了一把本地AI推理加速运行的效果。之后,一直想自己动手试一把底层算子开发,但是没找到合适的上手项目。

2025年年末,论坛开启了新一轮【开发者活动】,通过Spine-Triton这个开源项目,让开发者可以直接写 Triton Kernel,然后跑在 SpacemiT AI CPU上。

下面就是我的初步体验记录,希望对大家上手有所帮助。

- 安装最新的Bianbu v3.0.1镜像并完成基本设置。

- 把Spine-Triton项目下载到本地:

git clone https://github.com/spacemit-com/spine-triton.git

cd spine-triton - 按照QuickStart的前两个步骤完成PIP包的安装:

pip install PyYAML sympy torch opencv-python pybind11 --index-url https://git.spacemit.com/api/v4/projects/33/packages/pypi/simple

pip install triton --index-url https://git.spacemit.com/api/v4/projects/33/packages/pypi/simple - 安装系统缺少的几个包:

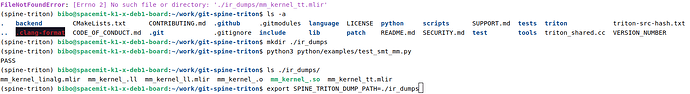

sudo apt install -y openmpi-bin libsleef3 libomp5 - (可选)创建本地ir_dumps目录:

export SPINE_TRITON_DUMP_PATH=./ir_dumps

mkdir ir_dumps

- 运行基本例程:

python3 python/examples/test_smt_mm.py